一、什么是BEV?

BEV是Bird's Eye View(视觉为中心的鸟瞰图)的简写,也称作“上帝视角”,是一种端到端的,由神经网络将图像信息从图像空间转换到BEV空间的技术。

与传统图像空间感知相比,BEV感知可将多个传感器采集的数据,输入到统一的空间进行处理,有效避免误差叠加;同时更易进行时序融合形成4D空间。

来源:百度

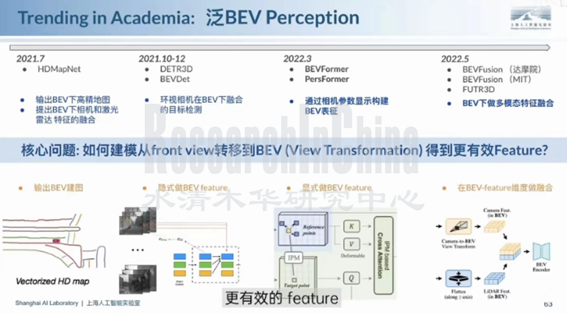

BEV并非新技术,2016年百度开始在BEV视角下实现点云感知;2021年特斯拉引入BEV后引发了业界的广泛关注。根据传感器输入层、基本任务,以及场景的不同,可给出相应的BEV感知算法。比如,基于纯视觉的BEVFormer算法、基于多模态融合策略的BEVFusion算法。

来源:上海人工智能实验室

二、BEV感知算法的三种技术路线

从BEV技术落地来看,各家技术架构大致相同,但采取的技术方案有所不同。迄今,大致出现了三种技术路线:

1. 纯视觉BEV感知路线,代表企业为特斯拉;

2. BEV融合感知路线,代表企业为毫末智行;

3. 车路一体BEV感知路线,代表企业为百度。

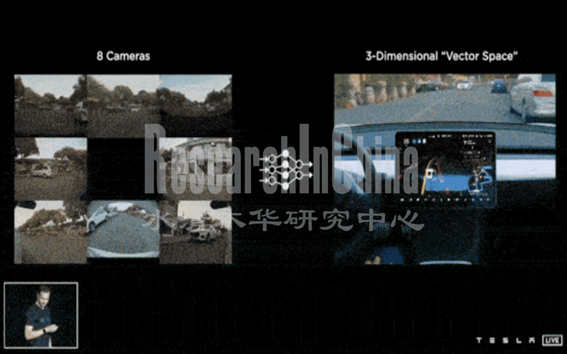

纯视觉BEV感知技术路线:特斯拉是纯视觉技术路线代表企业,2021年率先使用前融合BEV算法,将摄像头感知到的画面直接传到AI算法里,生成鸟瞰视角的3D空间,并在该空间内输出感知结果。包括汽车、行人等动态信息,车道线、交通标识、红绿灯、建筑物等静态信息,以及各元素的坐标位置、方向角、距离、速度、加速度等。

特斯拉利用8个摄像头采集数据通过神经网络输出3D向量空间

来源:特斯拉

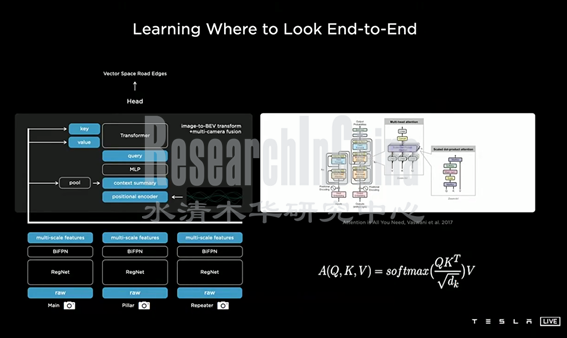

特斯拉主要利用主干网(Backbone)对各个摄像头进行特征提取(Feature);借助Transformer等技术将多摄像头数据从图像空间转化为BEV空间。Transformer是一种基于Attention机制的深度学习模型,能处理大规模数据级学习任务,精确感知和预测物体深度。

特斯拉在感知网络架构引入BEV三维空间转化层

来源:特斯拉

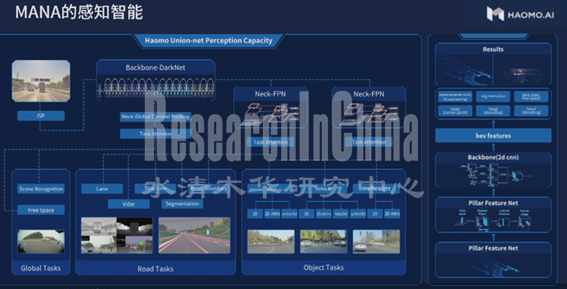

BEV融合感知技术路线:毫末智行是长城汽车旗下自动驾驶公司,2022年推出“重感知,轻地图”的城市NOH方案,核心技术来自MANA(雪湖体系)。

在MANA感知架构中,毫末智行采用了 BEV 融合感知(视觉Camera+Lidar)技术。利用自研的Transformer算法,MANA既完成了对纯视觉信息的BEV转化,也完成了Camera和Lidar特征数据的融合,即跨模态raw data的融合。

来源:毫末智行

自2021年底推出后,MANA持续演进,通过基于Transformer的感知算法解决了多个道路感知问题,如车道线检测、障碍物检测、可行驶区域分割、红绿灯检测&识别、道路交通标志检测等。

2023年1月,MANA进一步升级,引入五大模型,实现车端感知架构的跨代升级,完成了通用障碍物识别、局部路网、行为预测等任务。其中,五大模型包括视觉自监督大模型(实现4D Clip的自动标注)、3D重建大模型(低成本解决数据分布问题)、多模态互监督大模型(通用障碍物的识别)、动态环境大模型(使用重感知技术,降低对高精地图依赖)、人驾自监督认知大模型(驾驶策略更人性、安全、顺畅)。

毫末智行MANA体系感知算法迭代历程

来源:毫末智行

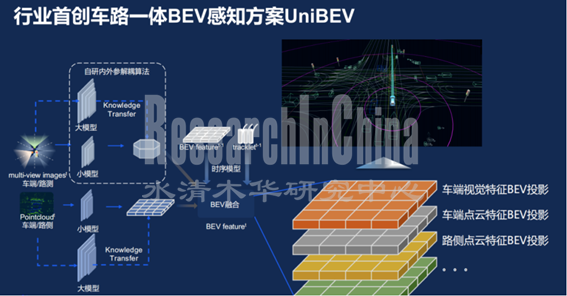

车路一体BEV感知技术路线:2023年1月,百度推出车路一体的解决方案UniBEV,是业内首个车路一体的端到端感知解决方案。

特点:

• 将车端、路端数据全部进行融合,包括车端多相机、多传感器的在线建图、动态障碍物感知,以及路侧视角下的多路口多传感器融合等;

• 自研内外参解耦算法,不管车端、路侧的传感器位置如何变化,UniBEV都可将其投影到统一的BEV空间下;

• 在统一的BEV空间,UniBEV更易实现多模态、多视角、多时间上的时空特征融合;

• 采用大数据+大模型+小型化的技术闭环,在车端路侧的动静态感知任务上更具优势。

来源:百度

百度UniBEV方案将应用在百度高阶智驾产品ANP3.0上,计划2023年量产交付。当前,百度已开始在北、上、广、深多地进行ANP3.0泛化测试。

百度ANP3.0采用“纯视觉+Lidar”的双冗余方案。研发测试阶段,依靠“BEV环视三维感知”技术,ANP3.0已成为依靠纯视觉实现城市域多场景的智驾⽅案。量产阶段,ANP3.0将引入激光雷达,实现多传感器融合感知,以应对更为复杂的城市场景。

三、BEV感知算法助力城市NOA落地

随着视觉算法的演进,BEV感知算法成为主机厂和自动驾驶公司发力城市场景的核心技术,如特斯拉、小鹏、长城、极狐汽车、轻舟智航、小马智行等。

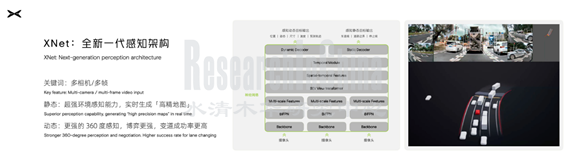

小鹏汽车:全新一代感知架构XNet 可将摄像头采集的数据,进行多帧时序前融合,输出BEV下的4D动态信息(如车辆速度、运动预测等)和3D静态信息(如车道线位置等)。

来源:小鹏汽车

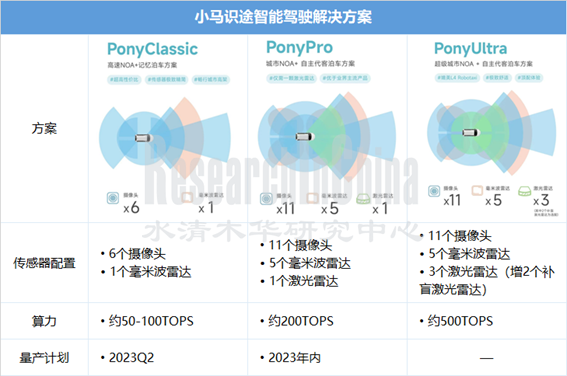

小马智行:2023年1月公布智能驾驶解决方案——小马识途,其关键能力就是自研BEV感知算法,可识别各类型障碍物、车道线及可通行区域等信息,最大限度降低算力需求,仅用导航地图就可实现高速与城市NOA。

来源:小马智行