2023年以来,越来越多车型开始接入大模型,越来越多Tier1推出汽车大模型解决方案。特斯拉FSD V12的出色进展和SORA的推出,更加速了AI大模型在座舱和智驾领域的落地。

端到端自动驾驶大模型的发展突飞猛进

2023年2月,采用端到端自动驾驶模型的特斯拉FSD v12.2.1已经开始陆续在美开启推送,不仅仅是员工和测试人员。根据首批客户的反馈,FSD V12 相当强大,让以前不相信不敢用自动驾驶的普通人也敢于使用FSD了。譬如,特斯拉 FSD V12 可绕行路边积水,一位特斯拉的工程师评论说:这种开法很难用明确的代码来实现,但特斯拉的端到端方案几乎毫不费力地实现了。

自动驾驶AI大模型的发展可以分为四个阶段:

▪1.0时代就是在感知层面使用大模型(Transformer);

▪2.0时代就是模块化,感知规控决策都用大模型;

▪3.0时代就是端到端大模型(一“端”是传感器的原始数据,另一“端”直接输出驾驶动作);

▪4.0时代就是从垂直领域的人工智能走向通用领域的人工智能(AGI的世界模型)。

现在多数公司处于2.0时代。特斯拉FSD V12已处于3.0时代。其他主机厂和Tier1纷纷跟进FSD V12的端到端大模型。2024年1 月 30 日,小鹏汽车宣布,小鹏的端到端模型下一步将会全面上车。据悉,蔚来和理想的“基于端到端”自动驾驶模型也将在2024年上线。

FSD V12驾驶决策交由AI算法生成,用海量视频数据训练出的端到端神经网络,替换掉了超过30万行C++代码。FSD V12提供了一条有待验证的全新路径,若得以走通,将对行业产生颠覆性影响。

2月16日,OpenAI发布文本生成视频模型SORA,标志着AI视频应用即将大规模应用的前夜。SORA不仅支持通过文本或图像生成长达60秒的视频,其视频生成能力、复杂场景和角色生成能力、以及对物理世界模拟的能力,都显著超越了之前的技术。

SORA和FSD V12都是通过视觉让AI能够理解甚至模拟真实的物理世界。Elon Mask认为,“FSD 12和Sora不过是AI通过视觉认知世界、理解世界上的两个开花结果,FSD最终用于驾驶行为,Sora则是用来生成视频。”

SORA的爆火,进一步证明了FSD V12的合理性。马斯克称「特斯拉已经能够制作真实世界视频大约一年了」。

来源:Twitter

AI大模型快速演化,带来全新机会

最近三年,自动驾驶大模型经历了若干次的演化,领先车企的自动驾驶系统几乎每年要重写一次。这也给后来者提供了切入机会。

CVPR2023上,商汤、OpenDriveLab、地平线等联合发布的端到端的自动驾驶算法UniAD,获得了2023年的最佳论文。

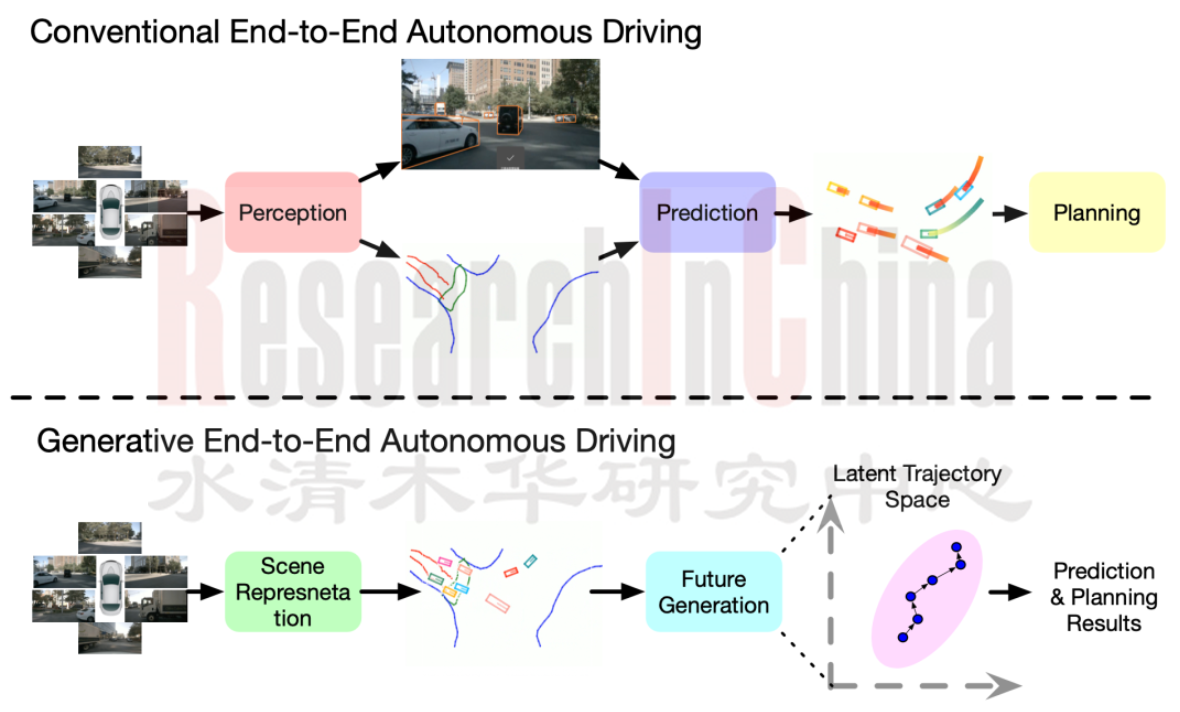

2024年初,中科慧拓技术团队和中科院自动化所共同提出的生成式端到端自动驾驶模型GenAD,将生成式人工智能(Generative AI)和端到端自动驾驶技术结合,是业界首个生成式端到端自动驾驶模型。该技术颠覆了UniAD的渐进式流程端到端方案,探讨了一种新的端到端自动驾驶范式,关键在于采用生成式人工智能的方式预测自车和周围环境在过去场景中的时序演变方式。

来源:中科慧拓

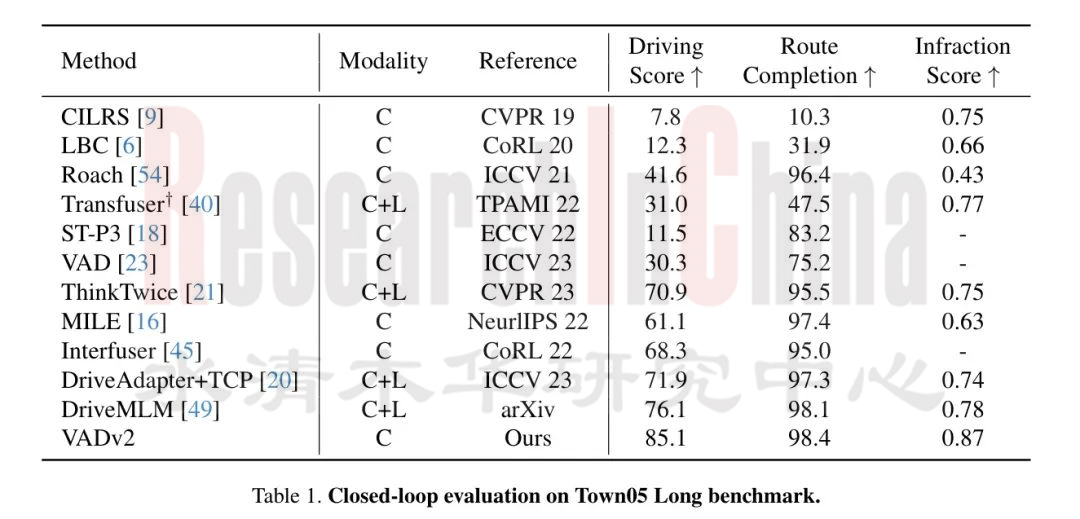

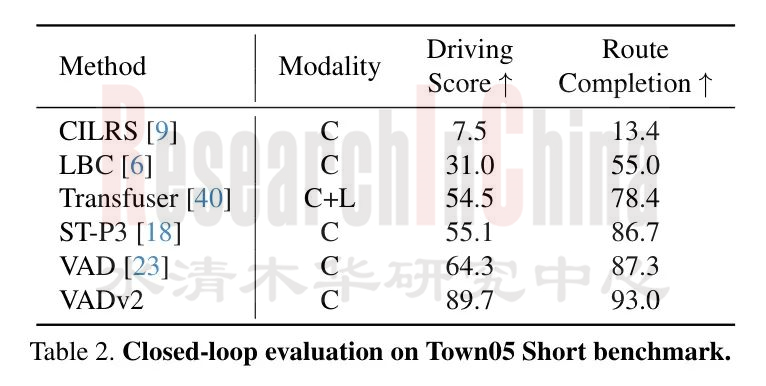

2024年2月,地平线和华中科技大学提出了VADv2,一个基于概率规划的端到端驾驶模型。VADv2以流方式输入多视角图像序列,将传感器数据转换为环境标记嵌入,输出动作的概率分布,并从中采样一个动作来控制车辆。仅使用摄像头传感器,VADv2在CARLA Town05基准测试中实现了最先进的闭环性能,显著优于所有现有方法。它能够在完全端到端的方式下稳定运行,甚至不需要基于规则的封装。

来源:地平线

在Town05长距离基准测试中,VADv2取得了85.1的驾驶分数,98.4的路程完成度,以及0.87的违规分数,如表1所示。与之前的最先进方法相比,VADv2在路程完成度更高的同时,显著提高了驾驶分数,增加了9.0。值得注意的是,VADv2仅使用摄像头作为感知输入,而DriveMLM同时使用了摄像头和激光雷达。此外,与之前仅依赖摄像头最佳方法相比,VADv2显示出更大的优势,驾驶分数的显著提高达到了16.8。

来源:地平线

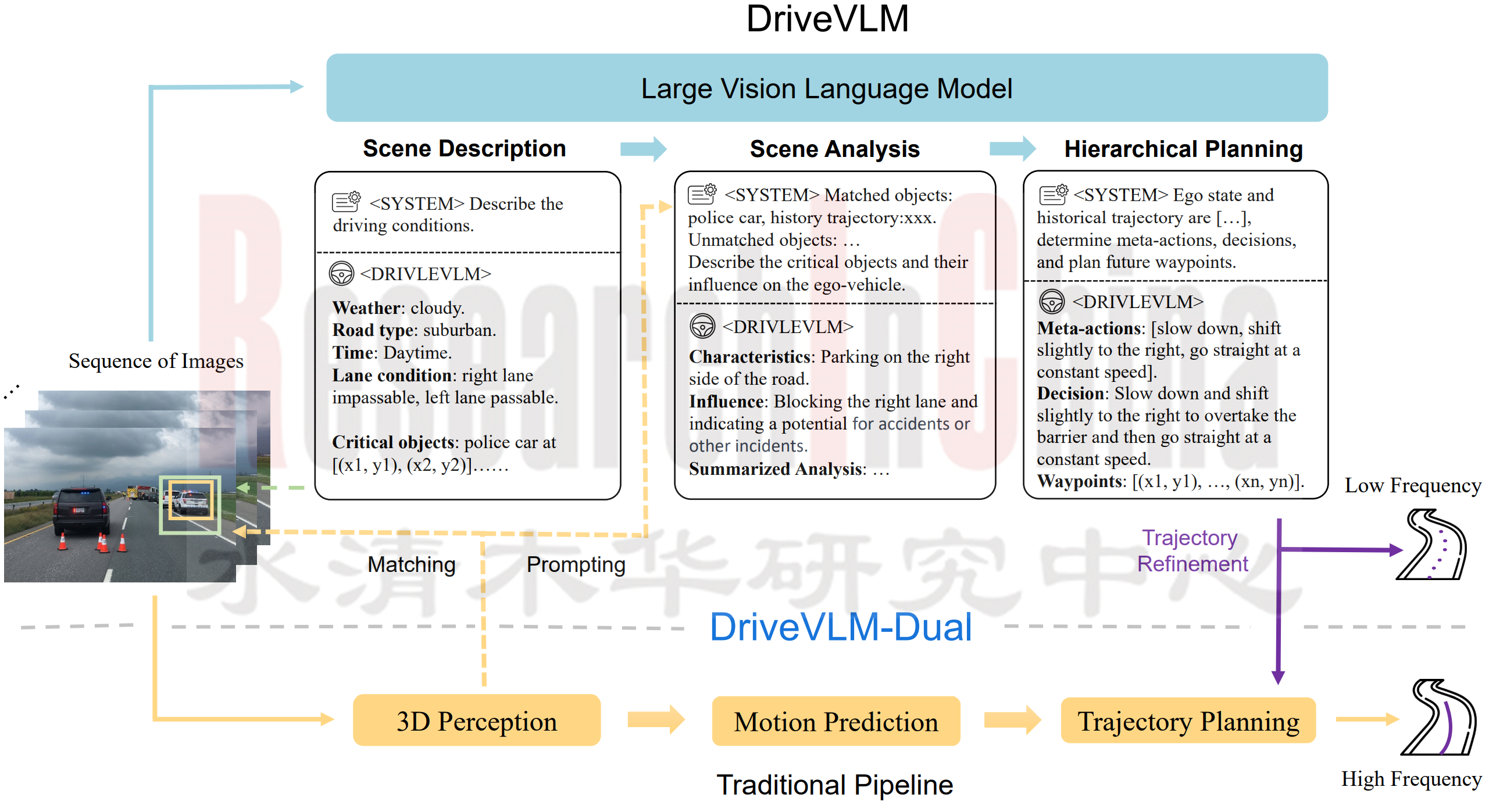

也是在2024年2月,清华大学交叉信息研究院和理想汽车提出了 DriveVLM。DriveVLM的整体流程如下图所示。一系列图像被大型视觉语言模型(VLM)处理,以执行特定的链式思维(CoT)推理,得出驾驶规划结果。这个大型VLM包括一个视觉编码器和一个大型语言模型(LLM)。

来源:清华大学交叉信息研究院

由于VLMs在空间推理和高计算需求方面的局限性,DriveVLM团队又提出了DriveVLM-Dual,一个结合了DriveVLM与传统自主驾驶流水线优势的混合系统。DriveVLM-Dual可选择性地将DriveVLM与传统的3D感知和规划模块相结合,例如3D目标检测器、占用网络和运动规划器,使系统能够实现3D定位和高频规划能力。这种双重系统设计,类似于人脑的慢速和快速思考过程,能够有效适应驾驶场景中不断变化的复杂性。

大模型兴起,AI和云计算公司受关注

AI大模型兴起,算力、算法和数据三者缺一不可。擅长算法,储备了大量算力的AI公司(如科大讯飞、商汤科技、旷视科技等),以及具备强大智算中心的云计算公司(如浪潮、火山引擎、腾讯云等)受到主机厂关注。

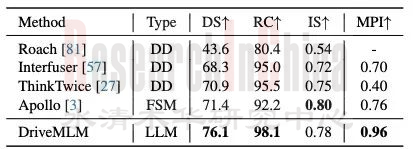

商汤在AI大模型领域布局了座舱多模态大模型SenseChat-Vision、AIDC智算中心(6000P算力)、自动驾驶大模型DriveMLM。2024年初,商汤推出DriveMLM,在闭环测试最权威榜单CARLA上取得很好的成绩。DriveMLM是介于模块化和端到端方案之间的中间方案,具备可解释性。

来源:商汤科技

在自动驾驶的Corner Case采集上,火山引擎和毫末智行一起将大模型应用在场景生成和标注提效上。在火山引擎提供的云服务能力支持下,毫末DriveGPT大模型的预标注,整体效率提升了10倍。

来源:腾讯

2023年,腾讯发布了在智能汽车云、智驾云图、智能座舱等领域的升级产品和方案。算力方面,腾讯智能汽车云带来3.2Tbps带宽,算力性能提升3倍,通信性能提升10倍,计算集群GPU利用率提升60%以上,为智能驾驶大模型训练提供高带宽、低延迟的智算能力支撑。在训练加速方面,腾讯智能汽车云结合太极Angel训练加速框架,训练速度相比业界主流框架提高1倍,推理速度相比业界主流框架提升1.3倍。博世、蔚来汽车、英伟达、奔驰、文远知行等企业目前都是腾讯智能汽车云的用户。2024年,腾讯将进一步加强AI大模型的建设。

01 自动驾驶算法分类与常见算法模型

1.1 自动驾驶系统分类和软件2.0

1.2 百度AD算法发展历程

1.2.1 百度AD算法发展历程:模型1.0

1.2.2 百度AD算法发展历程:感知1.0

1.2.3 百度AD算法发展历程:感知2.0

1.2.4 百度AD算法发展历程:感知大模型

1.2.5 百度AD算法发展历程:大模型应用案例

1.3 特斯拉AD算法发展历程

1.3.1 特斯拉AD算法发展历程(1)

1.3.2 特斯拉AD算法发展历程(2)

1.3.3 特斯拉AD算法发展历程(3)

1.3.4 特斯拉AD算法发展历程(4)

1.3.5 特斯拉Dojo 超算中心

1.4 神经网络模型

1.4.1 DNN

1.4.2 CNN

1.4.3 RNN

1.4.4 Transformer与大模型

1.4.5 占用网络

1.4.6 AI大模型的不足1

1.4.7 AI大模型的不足2

1.5 传统自动驾驶AI算法(小模型)

1.6 Transformer和BEV(大模型)

1.6.1 Transformer示意图

1.6.2 三种常见的Transformer

1.6.3 大模型的根基是Transformer

1.6.4 为什么需要大模型

1.6.5 没有Code,只有NAS

1.6.6 端到端,不添加人工规则

1.6.7 基于Transformer的端到端目标检测

1.6.8 BEV+Transformer是“特征级融合”

1.7 端到端大模型案例

1.7.1 端到端自动驾驶模型案例 (1)

1.7.2 端到端自动驾驶模型案例 (2)

1.7.3 端到端自动驾驶模型案例 (3)

02 AI模型和智算中心简介

2.1 AI大模型

2.1.1 AI大模型简介

2.1.2 AI大模型发展背景

2.1.3 AI大模型发展历程

2.1.4 AI大模型的地位

2.1.5 AI大模型的商业模式

2.1.6 AI大模型落地面临的挑战及未来发展趋势

2.1.7 大模型技术架构+参数规模持续迭代

2.2 AI大模型在汽车的应用

2.2.1 大模型在汽车的应用方向

2.2.2 大模型在智能座舱的应用(1)

2.2.3 大模型在智能驾驶的应用(2)

2.2.4 大模型在智能驾驶的应用(3)

2.2.5 AI大模型在汽车应用的挑战

2.2.6 已经和即将搭载 AI 大模型的国内车型

2.3 自动驾驶多模态基础大模型

2.3.1 自动驾驶AD基础大模型:应用场景

2.3.2 自动驾驶AD基础大模型:典型应用

2.3.3 自动驾驶AD基础大模型:典型应用和局限性分析

2.3.4 自动驾驶AD基础大模型:主要适配场景与应用

2.3.5 自动驾驶AD基础大模型:适配场景案例

2.3.6 自动驾驶AD基础大模型:世界模型与视频生成

2.3.7 自动驾驶视觉大基础模型VFM:适配场景与主要应用

2.3.8 自动驾驶视觉大基础模型VFM:仿真数据生成和场景重构

2.4 智算中心

2.4.1 智算中心简介

2.4.2 中国智算中心的发展历程

2.4.3 智算中心2.0时代

2.4.4 智算中心建设情况

2.4.5 智算中心产业链

2.4.6 智算中心总体架构图

2.4.7 智算中心发展趋势(1)

2.4.8 智算中心发展趋势(2)

2.4.9 智算中心发展趋势(3)

2.4.10 智算中心发展趋势(4)

2.4.11 自动驾驶领域建立智算中心的原因

2.4.12 搭建自动驾驶智算中心的成本

2.4.13 搭建自动驾驶智算中心遇到的问题

2.4.14 自动驾驶公司AI大模型和算力配置情况

2.4.15 主机厂导入大模型的模式

2.4.16 汽车行业大模型及智算中心进展汇总(供应商)

2.4.17 汽车行业大模型及智算中心进展汇总(主机厂)

03 特斯拉算法和大模型解析

3.1 特斯拉算法融合CNN和Transformer

3.1.1 特斯拉视觉感知框架发展历程

3.1.2 特斯拉视觉算法架构

3.1.3 特斯拉视觉算法架构(含NeRF)

3.1.4 特斯拉视觉算法的骨架、脖颈、头

3.1.5 特斯拉视觉系统核心HydraNet

3.1.6 特斯拉2D转3D图像

3.1.7 Swin Transformer与传统CNN骨干网的对比

3.1.8 特斯拉的骨干网RegNet

3.1.9 特斯拉视觉的BiFPN

3.2 Transformer将2D变3D

3.2.1 特斯拉Transformer、BEV与矢量空间表达

3.2.2 特斯拉Image-to-BEV Transformer

3.2.3 特斯拉Occupancy Network

3.2.4 DETR 3D架构

3.2.5 特斯拉Transformer模型

3.2.6 特斯拉3D目标检测

3.3 Occupancy Network与语义分割及时空序列

3.3.1 特斯拉视觉框架

3.3.2 3D目标检测与3D语义分割

3.3.3 反卷积Deconvolution

3.3.4 特斯拉视频神经网络架构

3.3.5 特征队列Feature Queue

3.3.6 特征队列Feature Queue - 时间序列

3.3.7 特征队列Feature Queue - 空间序列

3.4 LaneGCN与搜索树

3.4.1 特斯拉车道神经网络

3.4.2 特斯拉的矢量地图

3.4.3 LaneGCN架构

3.4.4 特斯拉的AR模型

3.4.5 特斯拉的轨迹规划MCTS

3.4.6 MCTS算法优化核心思想

3.5 数据闭环和数据引擎

3.5.1 特斯拉影子模式

3.5.2 特斯拉数据引擎

3.5.3 数据引擎案例

04 AI算法和大模型供应商研究

4.1 毫末智行

4.1.1 毫末智行简介

4.1.2 数据智能体系

4.1.3 智算中心

4.1.4 毫末智行对大模型的研究和应用

4.1.5 MANA的五大模型

4.1.6 自监督大模型

4.1.7 动态环境大模型

4.1.8 毫末的数据来源

4.1.9 五大模型及智算中心对毫末的助力

4.1.10 推出DriveGPT

4.1.11 DriveGPT和ChatGPT的对比

4.1.12 2023年毫末AI Day:自动驾驶语义感知大模型

4.1.13 2023年毫末AI Day:自动驾驶3.0时代

4.1.14 2023年毫末AI Day:引进外部大模型

4.1.15 2023年毫末AI Day:自动标注

4.2 轻舟智航

4.2.1 轻舟智航简介

4.2.2 轻舟智航的超融合感知框架

4.2.3 轻舟智航特征和时序融合大模型

4.2.4 OmniNet大模型推动量产方案的落地

4.2.5 轻舟智航的预测算法模型

4.2.6 自动驾驶研发工具链——轻舟矩阵

4.3 百度

4.3.1 百度Apollo和大模型

4.3.2 百度智能云AI大底座

4.3.3 文心大模型

4.3.4 文心大模型在汽车行业的应用

4.3.5 文心大模型提升百度感知算法能力

4.3.6 百度智算中心

4.3.7 百度正式发布文心一言

4.4 浪潮

4.4.1 浪潮集团简介

4.4.2 淮海智算中心的三大亮点

4.4.3 浪潮源2.0大模型

4.4.4 自动驾驶计算框架AutoDRRT

4.4.5 浪潮信息助力XX汽车智算中心建设

4.5 商汤科技

4.5.1 商汤科技简介

4.5.2 商汤日日新大模型底座

4.5.3 日日新·商量多模态大模型

4.5.4 商汤日日新大模型体系

4.5.5 商汤AIDC智算中心

4.5.6 商汤大模型在座舱领域的应用

4.5.7 商汤SenseAuto Empower

4.5.8 商汤UniAD大模型

4.5.9 商汤自动驾驶大模型

4.6 华为

4.6.1 华为盘古大模型3.0

4.6.2 预标注大模型

4.6.3 场景生成大模型和大模型降本

4.6.4 数据闭环工具链

4.6.5 华为算力规模

4.7 云知声

4.7.1 云知声推出山海大模型

4.7.2 云知声AI在座舱的应用

4.8 科大讯飞

4.8.1 科大讯飞发布“星火”认知大模型

4.8.2 “星火”认知大模型应用于智能座舱

4.8.3 在认知大模型的投入和价值实现方式

4.8.4 星火大模型V3.0升级座舱、音效、智驾功能

4.9 思必驰

4.9.1 思必驰发布语言大模型并与多家车企签约

4.9.2 DFM-2 大模型

4.9.3 思必驰大模型发展规划

4.9.4 思必驰大模型落地的汽车场景

4.10 旷视科技

4.10.1 旷视的自动驾驶方案

4.10.2 旷视的自动驾驶算法模型

4.10.3 旷视提出自动驾驶的通用世界模型

4.11 火山引擎

4.11.1 火山引擎简介

4.11.2 火山引擎推出火山方舟大模型

4.11.3 火山引擎的大模型落地实践

4.12 腾讯云

4.12.1 腾讯云简介

4.12.2 腾讯云助力智驾大模型落地

4.12.3 腾讯云的项目案例

4.13 其他企业

4.13.1 斑马智行

4.13.2 中科创达

4.13.3 地平线端侧部署大模型

........................

05 主机厂大模型应用研究

5.1 小鹏

5.1.1 小鹏简介

5.1.2 小鹏引入Transformer大模型

5.1.3 小鹏的数据处理

5.1.4 小鹏扶摇智算中心

5.1.5 小鹏大模型应用

5.1.6 小鹏XBrain智驾大模型

5.1.7 小鹏XGPT灵犀大模型

5.2 理想汽车

5.2.1 理想简介

5.2.2 大模型在理想自动驾驶的应用

5.2.3 NPN和TIN

5.2.4 动态BEV

5.2.5 DriveVLM-Dual:视觉语言大模型VLM+自动驾驶模块化流水线

5.2.6 理想大模型上车

5.2.7 理想汽车智能空间3.0接入Mind GPT

5.2.8 理想汽车大模型Mind GPT的进展

5.2.9 舱内交互能力与Mind GPT

5.3 吉利

5.3.1 公司简介

5.3.2 吉利星睿智算中心

5.3.3 吉利星睿智算中心的领先技术

5.3.4 吉利星睿智算中心的能力

5.3.5 吉利星睿AI大模型

5.3.6 吉利-百度·文心大模型

5.3.7 吉利OCC占用网络上车

5.4 比亚迪

5.4.1 比亚迪AI大模型布局

5.4.2 比亚迪璇玑架构

5.4.3 比亚迪璇玑架构:车端集成璇玑AI大模型

5.4.4 比亚迪璇玑架构:四链AI大模型布局

5.4.5 比亚迪璇玑架构:BEV感知模型

5.4.6 比亚迪璇玑架构:决策规划大模型

5.4.7 比亚迪整车智能AI大模型布局

5.4.8 比亚迪AI大模型发展规划

5.5 通用汽车

5.5.1 基于ChatGPT技术推出车载语音助手

5.5.2 通用汽车与谷歌开展AI合作

5.6 长安汽车

5.6.1 和百度合作布局AI大模型及智算中心

5.6.2 深蓝汽车Deepal OS 2.0内置Deepal GPT

5.7 其他车企

5.7.1 长城:全方位布局AI大模型

5.7.2 奇瑞:星途星纪元ES搭载认知大模型

5.7.3 广汽

5.7.4 上汽通用五菱

5.7.5 奔驰

5.7.6 大众

5.7.7 Stellantis

5.7.8 PSA

06 Sora、AI大模型的汽车应用趋势

6.1 Sora视频生成大模型解析

6.1.1 Sora文生视频大模型:基本功能

6.1.2 Sora文生视频大模型:应用案例

6.1.3 Sora文生视频大模型:案例分析

6.1.4 Sora文生视频大模型:基本原理与社会价值

6.1.5 Sora文生视频大模型:基本原理介绍

6.1.6 Sora文生视频大模型:优势与局限

6.1.7 Sora文生视频大模型:前景与未来

6.2 Sora底层算法架构解读

6.2.1 Sora文生视频大模型:基本系统介绍

6.2.2 解读Sora模块:Spacetime latent patches

6.2.3 解读Sora模块:Video compression network

6.2.4 解读Sora模块:Video compression network

6.2.5 解读Sora模块:Scaling transformers

6.3 生成世界模型与智能汽车行业

6.3.1 Sora文本生成视频大模型对智能汽车行业的影响分析与预测

6.3.2 Sora与Tesla FSD-GWM视频生成能力对比分析

6.3.3 Wayve生成式世界模型

6.3.4 Wayve生成式世界模型系统架构

6.3.5 KIT大学多模态生成式世界模型

6.4 AI大模型在汽车领域的应用趋势

6.4.1 趋势1

6.4.2 趋势1案例

6.4.3 趋势2

6.4.4 趋势3

6.4.5 趋势4

6.4.6 趋势5

6.5 AI大模型对芯片的要求

6.5.1 AI大模型对芯片的要求(1)

6.5.2 AI大模型对芯片的要求(2)

6.5.3 AI大模型对芯片的要求(3)

6.5.4 AI大模型对芯片的要求(4)

6.5.5 AI大模型对芯片的要求(5)

6.5.6 大模型时代,存储芯片很重要

6.5.7 如何解决存储瓶颈(1)

6.5.8 如何解决存储瓶颈(2)

6.5.9 如何解决存储瓶颈(3)

6.5.10 新势力学习特斯拉,自研NPU